Nano Banana Pro API превращает нейросеть из «кликабельного сервиса» в полноценный компонент вашего приложения: генерация изображений, редактирование, сохранение персонажей и работа с сериями картинок становятся функциями серверной части разработки.

Разработчик подключает API, а дальше Nano Banana Pro можно вызывать из веб‑интерфейса, мобильного приложения, CRM или внутренней админ‑панели.

Встраивать такие возможности удобнее через единую платформу нейросетей вроде FICHI.AI, где Nano Banana Pro живёт рядом с текстовыми, видео и музыкальными моделями и не требует отдельной инфраструктуры.

Архитектура Nano Banana Pro API и Vertex AI Studio

Как устроен Nano Banana Pro API

С точки зрения разработчика Nano Banana Pro API — это набор сетевых протоколов REST‑ или точек доступа, которые принимают:

- входные данные (текстовый запрос, изображение, маска, параметры генерации);

- настройки качества и размера (разрешение, количество вариантов, seed);

- опциональные параметры сохранения персонажей и истории проекта.

На выходе вы получаете ссылку на готовое изображение, набор кадров или JSON‑описание результата. API можно вызывать из любой базовой архитектуры: Node.js, Python, Go, Java или .NET — главное, корректно собрать запрос и обработать ответ.

Vertex AI Studio

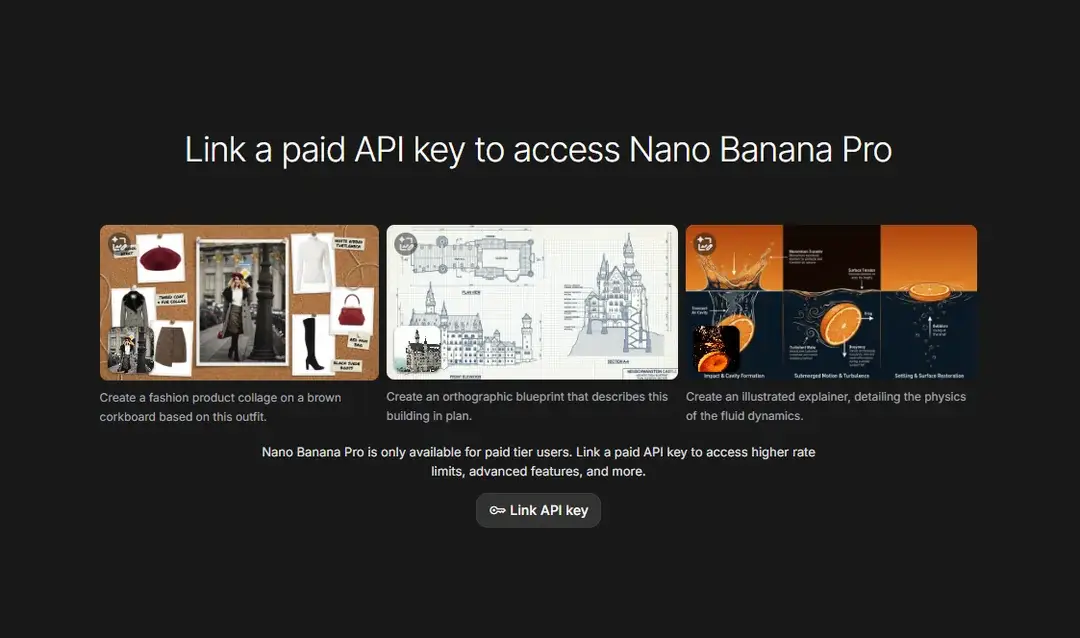

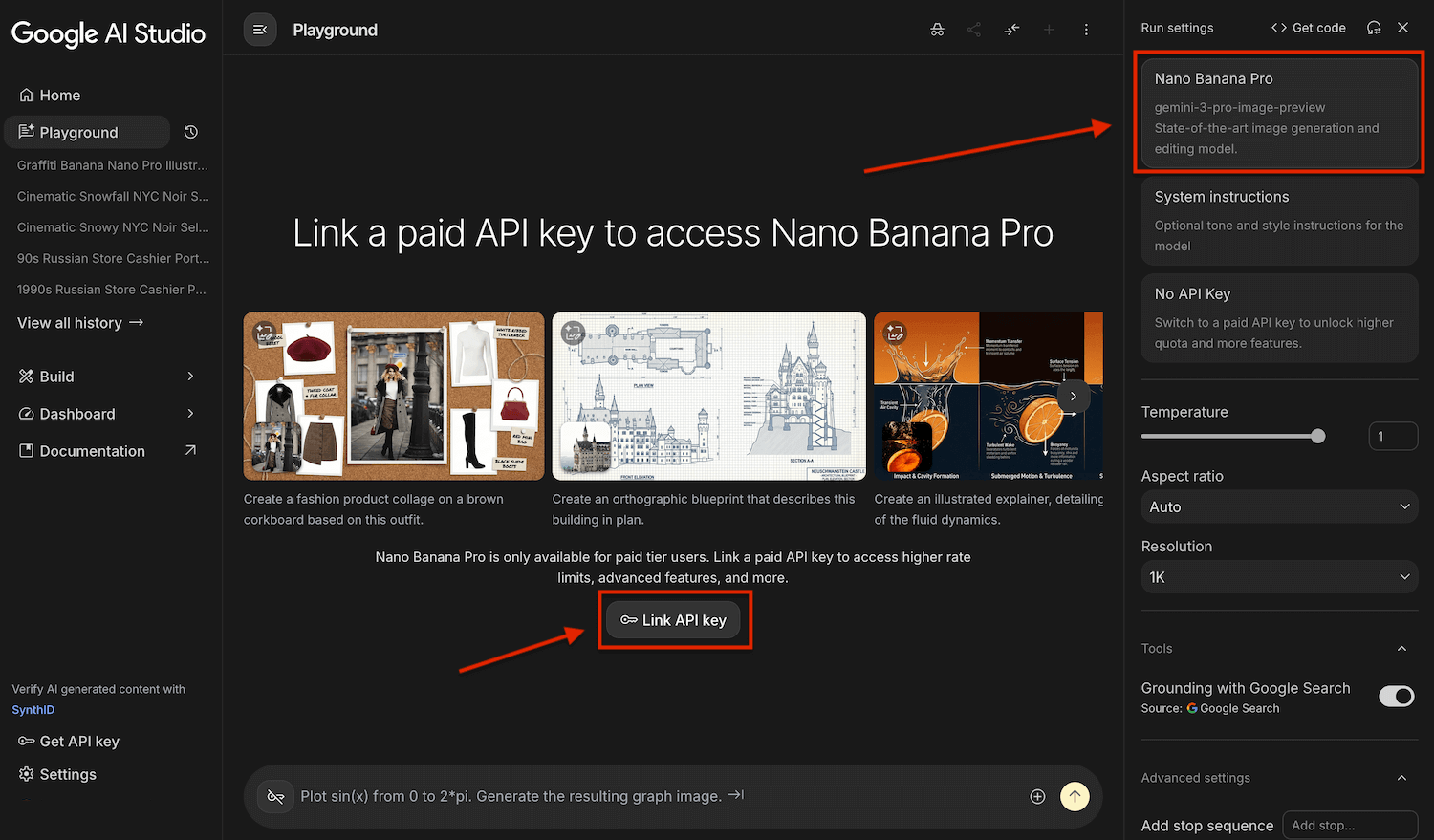

Типичный путь интеграции — Nano Banana Pro Vertex AI Studio: визуальная оболочка, через которую:

- создают и тестируют запросы;

- настраивают параметры модели (качество, стили, лимиты);

- собирают конвейер обработки данных и развертывают их как программный адрес для рабочих приложений.

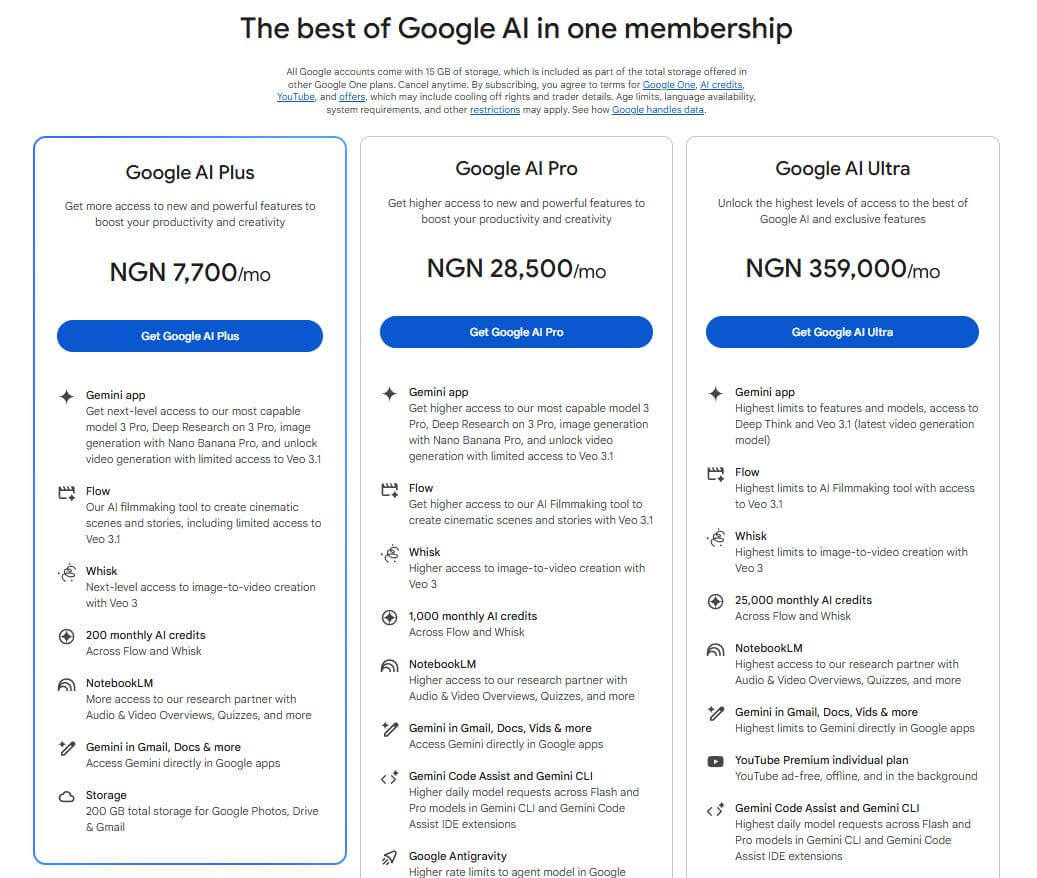

Vertex AI — это облачная платформа Google с поминутной оплатой ресурсов: около 0,134 $ за картинку в 2K и примерно 0,24 $ за 4K‑кадр. Формат удобен для автоматизации и крупных технологических цепочек, но при ручной генерации итоговая стоимость часто оказывается выше, чем у классической подписки.

Поэтому AI Studio сейчас рациональнее использовать с базовой Nano Banana: там комфортно собирать черновики, референсы и оттачивать промпты. А вот для Nano Banana Pro студийный сценарий даёт лишний слой сложности и затрат, который редко оправдывается — проще работать через связку с Gemini и тарифами Pro/Ultra.

Сначала вы отлаживаете логику в интерфейсе Studio: подбираете запрос, проверяете стабильность результата, тестируете разные разрешения и параметры. Затем одним кликом превращаете эту конфигурацию в API‑точку доступа и уже подключаете его в код продукта.

Nano Banana Pro для разработчиков: ключевые сценарии

Встраивание генерации изображений в продукт

Nano Banana Pro для разработчиков чаще всего используют для:

- генерации аватаров и обложек по описанию;

- автоматического создания иллюстраций к пользовательскому контенту;

- сборки макетов (упаковка, интерфейсы, сцены с продуктом) в онлайн-продажах и сетевых программных продуктах.

Пользователь вводит текст или выбирает готовую настройку, внешний интерфейс отправляет запрос к вашей внутренней части системы тот обращается в Nano Banana Pro API и возвращает ссылку на сгенерированное изображение. Дальше вы уже решаете, сохранять ли результат в своём объектном хранилище или работать напрямую по URL.

Редактирование и персонализация визуала

Второй популярный сценарий — интерактивное редактирование:

- загрузка существующего изображения;

- выделение области (маска) в клиентской части приложения;

- отправка маски и нового описания в Nano Banana Pro API.

Так строятся онлайн‑редакторы, где пользователь «по‑человечески» просит: «замени фон на ночной город», «поменяй цвет футболки на чёрный» или «добавь логотип на коробку». Внутренняя часть системы преобразует это в текстовый запрос, API возвращает обновлённую картинку.

Интеграция, лимиты и управление ресурсами

Nano Banana Pro интеграция в существующую архитектуру

При интеграции важно учитывать:

- отдельный сервис или модуль, который отвечает за работу с ИИ‑моделями (Nano Banana Pro, GPT‑модели, видео‑нейросети);

- очередь задач (например, очереди сообщений или автономные рабочие процессы), чтобы не блокировать ответ пользователю на время создания визуализации;

- буферизация результатов и исключение повторных обращений, чтобы не жечь лимиты лишний раз.

Хорошая практика — вынести всю работу с ИИ в единый «ИИ-шлюз» внутри проекта, который знает, как обращаться к Nano Banana Pro API, к текстовым моделям и к другим сервисам. Платформы типа FICHI.AI фактически дают такой узел доступа в готовом виде, остаётся лишь соединить их программный интерфейс с вашей внутренней частью системы.

Лимиты и модели оплаты

Любой Nano Banana Pro API работает в рамках лимитов:

- суточное/месячное количество запросов;

- ограничения по размеру и разрешению;

- ограничения по одновременным задачам.

На уровне кода — это:

- ограничение частоты запросов;

- обработка ошибок из‑за превышения лимитов;

- понижение разрешения или переход к очереди фоновой генерации.

Для тестов и пилотов обычно используется Nano Banana Pro бесплатная версия с жёсткими лимитами, после чего проект переходит на платную подписку с предсказуемой тарификацией.

Поддержка русского языка и локализация

Русский язык в текстовых запросах

Nano Banana Pro русский язык понимает на уровне описаний сцен: вы можете писать запросы по‑русски, а модель корректно интерпретирует персонажей, объекты и действия. Однако в производстве часто применяют двойной подход:

- пользователь пишет по‑русски;

- текстовая модель (GPT‑5, YandexGPT, Claude) внутри вашего сервиса переводит запрос на английский, нормализует структуру;

- уже нормализованный запрос уходит в Nano Banana Pro API.

Так вы минимизируете неоднозначности и получаете более стабильный результат. Всё это удобно делать на единой платформе, где и текстовые, и визуальные нейросети доступны через один API и один аккаунт — пример такого подхода показывает FICHI.AI в своих материалах по сравнению с YandexGPT и ChatGPT Plus.

Локализация интерфейса и контента

Кроме запросов, разработчикам важно:

- локализовать интерфейс под русскоязычную аудиторию;

- переводить подписи и надписи на самих изображениях (через отдельные модели перевода и распознавания);

- учитывать юридические аспекты использования ИИ‑контента в России.

Здесь Nano Banana Pro интеграция в инструментарий с другими ИИ‑моделями критична: текст обрабатывается языковыми моделями, изображения — Nano Banana Pro, а весь процесс управляется через общую API‑обвязку.

Почему имеет смысл использовать Nano Banana Pro через единую платформу

Подключать Nano Banana Pro напрямую к облаку — нормальный путь для крупной команды с отдельными специалистами по автоматизации разработки и эксплуатации. Но если задача — быстро добавить ИИ‑функции в продукт и не тратить недели на настройку, проще использовать платформу, которая уже:

- даёт доступ к Nano Banana Pro, текстовым и видеомоделям через единый API;

- Обеспечивает систему расчётов, контроль установленных норм и постоянное наблюдение;

- работает в России без VPN и с русскоязычной поддержкой.

Именно такой сценарий предлагает FICHI.AI: подключаете один API‑ключ, настраиваете необходимые модели (Nano Banana Pro для изображений, GPT‑5/Claude/Gemini для текста, Veo и Mureka для видео и музыки) и сразу тестируете интеграцию в боевом продукте. Это особенно удобно, когда нужно быстро проверить гипотезу: от прототипа в Vertex AI Studio до первых пользователей проходит не месяцы, а недели или даже дни.

Заключение

Nano Banana Pro API уже сейчас получают все условия, чтобы сделать создание и правку изображений обычной частью внутренней системы — фактически, ещё одной автономной службой наряду с платежным модулем или почтовым оповещением. В сочетании со средой разработки Vertex AI удобно выстраивать и проверять последовательности операций, а затем переносить их в рабочие точки доступа, не меняя текстовые команды под каждую новую возможность.

Чтобы не расходовать ресурсы на создание собственного ИИ-шлюза, контроль ограничений, систему расчётов и преодоление запретов доступа, целесообразно подключать Nano Banana Pro через единую платформу. FICHI.AI как раз реализует этот подход: единый код доступа, связь с Nano Banana Pro, текстовыми моделями уровня GPT‑5 и Gemini, нейронными сетями для создания видео и музыки. Дополнительно предоставляется поддержка на русском языке и удобное использование в России без VPN.