Mistral AI — парижский стартап, который за полтора года стал крупнейшим европейским игроком на рынке искусственного интеллекта. Компания разрабатывает большие языковые модели с открытыми весами, которые конкурируют с решениями от OpenAI и Google.

Вы узнаете, как три бывших сотрудника DeepMind создали компанию стоимостью 14 млрд долларов, какие технологии лежат в основе их моделей и как использовать Mistral AI в своих проектах.

История создания и развития Mistral AI

Основание компании и команда основателей

Компания Mistral AI была основана в апреле 2023 года тремя французскими исследователями в области искусственного интеллекта. Артур Менш стал генеральным директором, Гийом Лампль занял должность главного научного сотрудника, а Тимоте Лакруа возглавил техническое направление как технический директор. Все трое познакомились во время обучения в престижной французской инженерной школе École Polytechnique.

До основания Mistral AI основатели работали в ведущих технологических компаниях мира. Артур Менш почти три года провёл в Google DeepMind, где занимался разработкой передовых систем искусственного интеллекта. Гийом Лампль и Тимоте Лакруа участвовали в проектах по созданию крупномасштабных языковых моделей. Лакруа также окончил École Normale Supérieure — одно из самых престижных французских учебных заведений.

Команда основателей поставила перед собой амбициозную цель — создать европейскую альтернативу американским гигантам в сфере ИИ. Они выбрали подход открытого искусственного интеллекта, делая свои модели доступными для широкого круга разработчиков. Название компании отсылает к мистралю — холодному и мощному северо-западному ветру, который дует в южной Франции. Этот образ отражает философию стартапа — стремительность развития и способность изменить направление в индустрии.

Инвестиционные раунды и финансирование

Первый раунд финансирования Mistral AI провела уже через два месяца после основания — в июне 2023 года. Компания привлекла 105 млн евро от американского фонда Lightspeed Venture Partners, рекламной корпорации JCDecaux, бывшего главы Google Эрика Шмидта и французского миллиардера Ксавье Ниэля. Эти инвестиции оценили молодой стартап в 240 млн евро, что стало рекордом для компании на столь ранней стадии.

Второй инвестиционный раунд состоялся в декабре 2023 года и принёс компании 385 млн евро. В числе инвесторов оказались влиятельный калифорнийский фонд Andreessen Horowitz, французская финансовая группа BNP Paribas и корпорация Salesforce. После этого раунда оценка Mistral AI превысила 2 млрд долларов — компания официально вошла в число технологических единорогов.

В июне 2024 года Mistral AI провела раунд серии B, привлекая рекордные 600 млн евро под руководством венчурного фонда General Catalyst. Оценка компании выросла до 5,8 млрд евро (6,2 млрд долларов). По этому показателю стартап занял четвёртое место в мире среди компаний, занимающихся искусственным интеллектом, и первое место за пределами области залива Сан-Франциско. В раунде также участвовали существующие инвесторы, включая DST Global и французский государственный фонд Bpifrance.

Самый крупный раунд финансирования произошёл в сентябре 2025 года. Mistral AI привлекла около 2 млрд евро инвестиций при оценке в 12 млрд евро (14 млрд долларов). Ключевым инвестором выступила нидерландская компания ASML Holding — мировой лидер в производстве оборудования для микроэлектроники. Она вложила 1,3 млрд евро и получила 11% акций компании. Эта сделка более чем удвоила оценку стартапа по сравнению с июнем 2024 года и сделала трёх основателей первыми миллиардерами Франции в сфере искусственного интеллекта — состояние каждого из них оценивается примерно в 1,1 млрд долларов.

Ключевые этапы развития

Первую языковую модель Mistral 7B компания выпустила уже в сентябре 2023 года — спустя пять месяцев после основания. Модель с 7 млрд параметров распространялась под свободной лицензией Apache 2.0, что позволяло разработчикам свободно использовать и модифицировать её. Компания даже распространяла модель через торрент-файл размером 13,4 гигабайта — нестандартный подход, который привлёк внимание сообщества разработчиков.

В декабре 2023 года Mistral AI представила Mixtral 8x7B — более мощную модель с архитектурой Mixture of Experts. Эта модель содержала 46,7 млрд параметров, но использовала только 12,9 млрд для обработки каждого токена. Благодаря этому Mixtral работала со скоростью модели размером 12,9 млрд параметров, но показывала производительность, сопоставимую с гораздо более крупными моделями. Mixtral превзошла в большинстве тестов и показала результаты на уровне GPT-3.5.

Февраль 2024 года ознаменовался стратегическим партнёрством с Microsoft. Корпорация вложила 16 млн долларов в Mistral AI и разместила языковые модели стартапа на своей облачной платформе Azure. Одновременно был запущен многоязычный чат-ассистент Le Chat — прямой конкурент ChatGPT. Название отсылает к английскому слову chat (чат), но одновременно является французским словом, означающим кота, что отражено в логотипе сервиса.

В апреле 2024 года компания выпустила Mixtral 8x22B — ещё более мощную модель с 141 млрд параметров, из которых активно использовались 39 млрд. Модель продемонстрировала высокие результаты в генерации кода и математических вычислениях. В том же месяце было объявлено о партнёрстве с крупной судоходной компанией CMA CGM на сумму 100 млн евро.

Июль 2024 года стал месяцем выхода флагманской модели Mistral Large 2 со 123 млрд параметров и контекстным окном в 128 000 токенов. Эта модель показала производительность на уровне GPT-4o, Claude 3 Opus при значительно меньшем количестве параметров. В ноябре 2024 года в Le Chat добавили возможность генерации изображений с помощью модели Flux Pro от Black Forest Labs, а в феврале 2025 года выпустили мобильные приложения для iOS и Android.

Позиционирование на рынке ИИ

Mistral AI позиционирует себя как главную европейскую альтернативу американским гигантам вроде OpenAI, Anthropic и Google. Это не просто маркетинговый ход — компания действительно стала единственным крупным европейским разработчиком генеративного искусственного интеллекта. Президент Франции Эммануэль Макрон неоднократно называл Mistral примером того, как Европа может конкурировать с Кремниевой долиной и укреплять собственный технологический суверенитет.

Французские власти рассматривают Mistral AI как стратегический проект в контексте цифровой независимости Европы. Артур Менш подчёркивает, что компания несёт особую ответственность как единственный европейский разработчик генеративного ИИ. По его словам, Европа должна продвигаться в этой области, чтобы снизить зависимость от Соединённых Штатов и сохранить контроль над критически важными технологиями.

На мировом рынке Mistral AI конкурирует с компаниями, оценка которых значительно выше. OpenAI потенциально стоит около 500 млрд долларов, а Anthropic — 183 млрд долларов. Однако стратегия Mistral AI отличается от конкурентов — компания делает акцент на открытых моделях и решениях для промышленности. Это привлекает инвесторов вроде Nvidia и ASML, которые видят в Mistral партнёра для развития европейской экосистемы искусственного интеллекта.

По состоянию на 2025 год в Mistral AI работает около 350 сотрудников, а офисы компании расположены в Париже, Лондоне, Люксембурге, Сингапуре и Соединённых Штатах. Общая сумма контрактов с момента основания превысила 1,6 млрд долларов. Компания ожидает, что годовая выручка превысит 100 млн долларов. При этом основатели и сотрудники сохраняют контрольный пакет акций, что обеспечивает независимость в принятии стратегических решений.

Языковые модели Mistral

Mistral 7B — первая модель

Mistral 7B стала дебютной моделью компании, выпущенной в сентябре 2023 года. Модель содержит 7 млрд параметров и распространяется под лицензией Apache 2.0, что позволяет свободно использовать её в любых целях — от коммерческих проектов до научных исследований. Разработчики могут запускать Mistral 7B локально на своих серверах, разворачивать на облачных платформах AWS, Google Cloud Platform или Azure либо использовать через платформу HuggingFace.

Архитектура Mistral 7B включает несколько инновационных решений. Модель использует групповое запросное внимание (grouped-query attention), которое ускоряет процесс генерации текста. Также применяется механизм скользящего окна внимания (sliding window attention), где каждый слой обрабатывает предыдущие 4096 скрытых состояний. Это позволяет эффективно работать с последовательностями произвольной длины при сниженных вычислительных затратах.

Компания также выпустила инструктированную версию Mistral 7B Instruct, которая обучалась на публично доступных датасетах с HuggingFace без использования проприетарных данных. Эта версия превзошла все модели с 7 млрд параметров в бенчмарке MT-Bench и сравнялась с чат-моделями размером 13 млрд параметров. Модель получила оценку 7,6 баллов в MT-Bench и работает только с английским языком.

Mixtral 8x7B — модель с экспертами

Mixtral 8x7B представляет собой разреженную смесь экспертов (Sparse Mixture of Experts) — архитектуру, которая радикально отличается от традиционных языковых моделей. Модель состоит из восьми отдельных экспертов, каждый из которых представляет собой нейронную сеть размером примерно 7 млрд параметров. Общее количество параметров достигает 46,7 млрд, однако для обработки каждого токена используется только 12,9 млрд параметров.

Принцип работы архитектуры MoE заключается в том, что на каждом уровне сети специальная маршрутизирующая подсеть выбирает двух из восьми экспертов для обработки токена. Выходные данные этих экспертов затем объединяются аддитивно. Благодаря этому Mixtral обрабатывает входные данные и генерирует выходные с той же скоростью и стоимостью, что и модель размером 12,9 млрд параметров. При этом показывает производительность значительно более крупных моделей.

Модель сопоставима с GPT-3.5 или превосходит его по большинству стандартных тестов. Особенно впечатляющие результаты Mixtral показывает в генерации кода и математических вычислениях. Модель поддерживает пять языков — английский, французский, испанский, итальянский и немецкий.

Контекстное окно Mixtral составляет 32 000 токенов, что позволяет обрабатывать значительные объёмы текста за один запрос. Модель доступна под лицензией Apache 2.0 и может использоваться в коммерческих проектах без ограничений. Инструктированная версия Mixtral 8x7B Instruct получила оценку 8,3 в бенчмарке MT-Bench, что делает её одной из лучших открытых моделей на момент выпуска.

Mistral Large и другие модели

Mistral Large 2, выпущенная в июле 2024 года, стала флагманской моделью компании. Она содержит 123 млрд параметров и обладает контекстным окном в 128 000 токенов — это эквивалент примерно 300-страничной книги. Модель спроектирована для работы на одном узле инференса, что делает её экономически эффективной для приложений, требующих обработки больших контекстов.

Многоязычность — одна из сильных сторон Mistral Large 2. Модель понимает и генерирует текст на 13 языках — английском, французском, немецком, испанском, итальянском, португальском, арабском, хинди, русском, китайском, японском и корейском. Также поддерживается более 80 языков программирования, включая Python, Java, C, C++, JavaScript и Bash. Это делает модель универсальным инструментом для международных проектов.

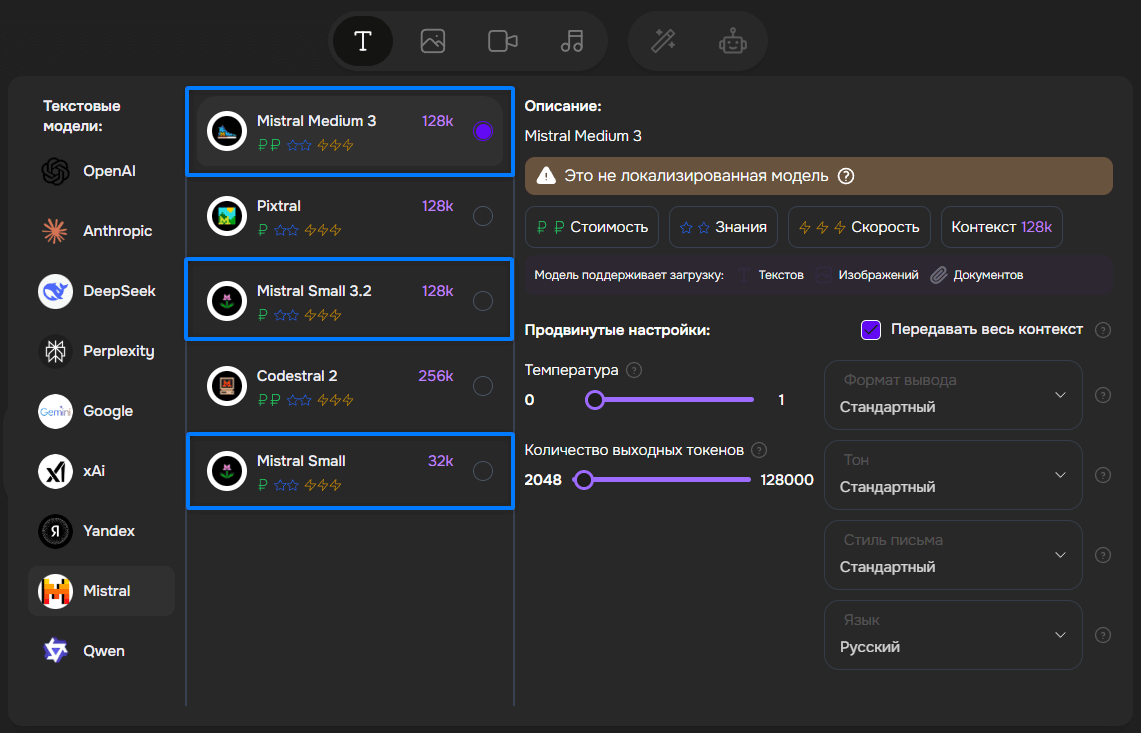

Среди других моделей стоит отметить Mistral Nemo — компактную модель, выпущенную в июле 2024 года, которая предлагает современную производительность в своей категории размеров. Codestral, представленная в мае 2024 года, специализируется на генерации кода. Также существуют специализированные версии Mathstral для математических задач и Codestral Mamba с альтернативной архитектурой. В декабре 2024 года компания выпустила Pixtral Large — мультимодальную модель со 124 млрд параметров, способную обрабатывать изображения и текст.

Открытые веса и доступность

Философия открытого искусственного интеллекта — ключевой принцип Mistral AI. Компания выпускает многие свои модели с открытыми весами под лицензией Apache 2.0, что позволяет разработчикам свободно использовать, модифицировать и распространять их. К таким моделям относятся Mistral 7B, Mixtral 8x7B, Mixtral 8x22B, а также специализированные версии вроде Codestral и Mistral Nemo.

Лицензия Apache 2.0 не накладывает ограничений на коммерческое использование. Разработчики могут интегрировать эти модели в свои продукты, дообучать их на собственных данных и развёртывать в любой инфраструктуре — от локальных серверов до публичных облаков. Это делает технологии Mistral AI доступными не только крупным корпорациям, но и стартапам, научным организациям и независимым разработчикам.

Открытость способствует инновациям и прозрачности. Исследователи могут изучать архитектуру моделей, проверять их на предвзятость и безопасность, создавать улучшенные версии. Сообщество разработчиков активно создаёт инструменты и библиотеки для работы с моделями Mistral AI. На платформе HuggingFace доступны веса всех открытых моделей, а также примеры их использования с популярными библиотеками вроде Transformers.

Однако не все модели Mistral AI полностью открыты. Флагманская Mistral Large 2 распространяется под Mistral Research License, которая разрешает использование и модификацию только для исследовательских и некоммерческих целей. Для коммерческого использования с самостоятельным развёртыванием необходимо приобрести Mistral Commercial License, связавшись с компанией. Такой подход позволяет Mistral AI монетизировать свои передовые разработки, сохраняя при этом доступность для научного сообщества.

Технологии и инновации

Архитектурные решения

Архитектура моделей Mistral AI включает несколько инновационных технологий, которые обеспечивают баланс между производительностью и эффективностью. Одно из ключевых решений — групповое запросное внимание (grouped-query attention или GQA). Этот механизм позволяет ускорить генерацию текста за счёт оптимизации процесса обработки запросов. Вместо того чтобы каждый элемент внимания работал независимо, GQA группирует запросы, что снижает вычислительную нагрузку.

Механизм скользящего окна внимания (sliding window attention или SWA) — ещё одна важная особенность архитектуры Mistral. В традиционных трансформерах каждый токен должен обращаться ко всем предыдущим токенам в последовательности, что создаёт квадратичную сложность. SWA решает эту проблему — каждый слой модели обрабатывает только предыдущие 4096 скрытых состояний. Это позволяет эффективно работать с последовательностями произвольной длины при существенно сниженных затратах на инференс.

Архитектура Mixture of Experts (смесь экспертов) в моделях Mixtral представляет собой революционный подход. Вместо одной большой нейронной сети модель состоит из восьми специализированных экспертов. На каждом слое маршрутизирующая подсеть динамически выбирает двух экспертов для обработки конкретного токена. Эксперты могут различаться на разных слоях, что позволяет создавать сложные пути обработки информации. Такой подход делает обучение и инференс значительно быстрее по сравнению с традиционными моделями аналогичной мощности.

Все эти архитектурные решения работают в связке, создавая модели, которые одновременно мощные и эффективные. Результат — языковые модели, способные конкурировать с гораздо более крупными системами при меньших вычислительных затратах. Это критически важно для коммерческого применения, где стоимость инференса напрямую влияет на рентабельность проектов.

Обучение и оптимизация моделей

Процесс обучения моделей Mistral AI опирается на передовые методы машинного обучения и мощную вычислительную инфраструктуру. Компания использует данные, извлечённые из открытого интернета, для предобучения своих моделей. Для обучения Mistral 7B и более крупных моделей использовались вычислительные кластеры с тысячами графических процессоров. Их предоставили партнёры вроде CoreWeave и итальянской суперкомпьютерной инфраструктуры CINECA/EuroHPC.

Инструктированные версии моделей проходят дополнительное обучение на наборах данных с инструкциями, доступных на платформе HuggingFace. Mistral AI придерживается принципа прозрачности — компания не использует проприетарные данные для дообучения своих открытых моделей. Это позволяет исследовательскому сообществу воспроизводить результаты и создавать собственные улучшенные версии.

Особое внимание уделяется оптимизации производительности на этапе инференса. Mistral AI тесно сотрудничает с разработчиками библиотек FlashAttention, vLLM и xFormers для интеграции оптимизаций. Модели совместимы с современными инструментами оптимизации, такими как квантизация с помощью bitsandbytes и эффективное дообучение через библиотеку PEFT. Это делает развёртывание моделей доступным даже на ограниченном оборудовании.

Для более продвинутых моделей, таких как Mistral Large 2, компания разработала инновационные подходы к обучению с подкреплением. Одно из достижений — система онлайн-обучения с подкреплением, которая позволяет моделям непрерывно улучшаться в процессе генерации ответов. Технический прорыв заключается в синхронизации обновлений весов модели между сотнями GPU в режиме реального времени — процесс, который обычно занимает часы, сократился до нескольких секунд.

Безопасность и контроль

Безопасность искусственного интеллекта — приоритетное направление для Mistral AI. Компания работает над минимизацией проблемы галлюцинаций — ситуаций, когда модель генерирует правдоподобную, но ложную информацию. При обучении Mistral Large 2 особое внимание уделялось тому, чтобы модель признавала отсутствие знаний вместо придумывания ответов. Это критически важно для применения в бизнесе, где точность информации напрямую влияет на принятие решений.

Модели Mistral AI поддерживают механизмы модерации контента. Хотя базовые модели не имеют встроенных ограничений, их можно настроить через промпты для блокировки нежелательных выходных данных. Компания предоставляет примеры таких промптов и рекомендует использовать дополнительное дообучение для приведения моделей в соответствие с требованиями безопасности. Платформа La Plateforme включает встроенные средства безопасности и настраиваемые ограждения для обеспечения ответственного поведения моделей.

Особое внимание компания уделяет европейским стандартам защиты данных. Все модели, развёрнутые на инфраструктуре Mistral AI в Европе, полностью соответствуют требованиям GDPR. Компания предлагает опцию нулевого хранения данных — информация, переданная через API, не сохраняется на серверах. Это критически важно для организаций, работающих с конфиденциальными данными — банков, медицинских учреждений, государственных органов.

Для корпоративных клиентов доступна возможность развёртывания моделей на собственной инфраструктуре. Это обеспечивает полный контроль над данными и соответствие внутренним политикам безопасности. Mistral AI также работает над интеграцией в on-premises среды, позволяя компаниям использовать мощные языковые модели для анализа внутренних документов без передачи информации в облако. Такой подход особенно востребован в оборонной промышленности и финансовом секторе.

Multilingual возможности

Mistral Large 2 поддерживает 13 естественных языков — английский, французский, немецкий, испанский, итальянский, португальский, арабский, хинди, русский, китайский, японский и корейский. Важно, что модель не просто переводит с английского — она демонстрирует нативное понимание и генерацию на каждом из этих языков. Это включает понимание культурных контекстов, идиом и специфических особенностей каждого языка.

Особенность моделей Mistral — способность к мультиязычному рассуждению. Когда модель обрабатывает сложный запрос, требующий пошаговой логики, она может вести цепочку рассуждений на языке пользователя, а не переключаться на английский, как это делают многие конкуренты. Это делает процесс рассуждения прозрачным и понятным для пользователей, говорящих не на английском языке.

Обучение на многоязычных данных требует особых методов и больших вычислительных ресурсов. Mistral AI сотрудничает с академическими организациями, включая École Polytechnique и Université de Montréal, для исследования производительности многоязычных моделей на языках с ограниченными ресурсами. Компания также работает с французским национальным институтом цифровых наук Inria над оптимизацией архитектур трансформеров для более эффективной обработки множества языков.

Продукты и сервисы

La Plateforme — платформа для разработчиков

La Plateforme — центральный сервис Mistral AI для разработчиков, доступный по адресу console.mistral.ai. Это комплексная платформа, которая предоставляет доступ ко всем моделям компании через API, инструменты для настройки и дообучения, а также средства мониторинга и управления. Платформа позволяет разработчикам экспериментировать с моделями, создавать прототипы приложений и масштабировать решения до промышленного уровня.

С сентября 2024 года La Plateforme предлагает бесплатный тарифный план, который позволяет разработчикам начать работу без финансовых вложений. Бесплатный тариф включает доступ к открытым моделям вроде Mistral 7B и Mixtral 8x7B с ограничениями примерно в 1 запрос в секунду, 500 000 токенов в минуту и до 1 млрд токенов в месяц. Этого достаточно для экспериментов, оценки моделей и создания прототипов.

Коммерческие тарифы предоставляют доступ к премиальным моделям, более высокие лимиты скорости и опции по изоляции данных. В сентябре 2024 года Mistral AI значительно снизила цены — на 33—80% в зависимости от модели. Например, стоимость миллиона входных токенов для Mistral Small упала с 1 доллара до 0,2 доллара. Mistral Large 2 позиционируется как самая экономически эффективная флагманская модель на рынке. Пользователи могут легко перейти с бесплатного на коммерческий тариф по мере роста своих проектов.

Платформа предлагает полный набор инструментов для разработки AI-приложений. Это включает fine-tuning для адаптации моделей под специфические задачи, API для эмбеддингов для семантического поиска и RAG-приложений, function calling для интеграции моделей с внешними системами, а также инструменты для дистилляции моделей — создания более компактных версий без существенной потери качества. Доступны официальные SDK для Python и TypeScript/JavaScript, что упрощает интеграцию в существующие проекты.

Le Chat — чат-интерфейс

Le Chat — конкурент ChatGPT от Mistral AI, запущенный в феврале 2024 года. Название обыгрывает двойное значение — по-французски le chat означает и чат, и кота, что отражено в логотипе сервиса. Первоначально доступный только через веб-интерфейс, в феврале 2025 года Le Chat вышел на мобильные платформы iOS и Android. За первые две недели после запуска мобильных приложений сервис преодолел отметку в 1 млн загрузок и занял первое место среди бесплатных приложений в французском App Store.

Основные возможности Le Chat включают ответы на вопросы, создание и редактирование текстов, поиск и анализ данных, генерацию идей и написание кода. В ноябре 2024 года добавилась функция генерации изображений с помощью модели Flux Pro от Black Forest Labs. Пользователи могут создавать изображения по текстовым описаниям, а затем итеративно редактировать их — например, изменить фон, сохранив основные объекты неизменными. Это особенно полезно для создания серий изображений, где важна визуальная согласованность.

В ноябре 2024 года Le Chat получил функцию поиска в интернете с цитированием источников, аналогично ChatGPT. Также появился инструмент Canvas, позволяющий редактировать контент — макеты веб-страниц, визуализации данных, документы — прямо в интерфейсе без необходимости регенерации полного ответа. Пользователи могут версионировать черновики и предварительно просматривать свои дизайны. Le Chat умеет обрабатывать большие PDF-документы и изображения, включая файлы с графиками и уравнениями.

В 2025 году Le Chat получил режим глубоких исследований (Deep Research), который проводит комплексный анализ по запросу пользователя, используя множество источников. Добавлен голосовой режим на основе модели Voxtral, поддерживающий естественные разговоры с низкой задержкой и автоматическое переключение между языками. Функция Projects позволяет группировать чаты, документы и идеи в тематические пространства. В сентябре 2025 года появилась функция памяти (Memories), которая запоминает предпочтения пользователя и контекст между разговорами. Все эти функции доступны бесплатно на начало 2025 года, хотя компания также предлагает Pro-подписку за 14,99 доллара в месяц с доступом к более продвинутым моделям и безлимитным сообщениям.

Корпоративные решения

Mistral AI предлагает специализированные решения для корпоративных клиентов, которые требуют повышенного уровня безопасности, настройки и поддержки. Корпоративные версии Le Chat могут подключаться к внутренним данным компании без передачи информации в облако. Это позволяет использовать возможности глубоких исследований и анализа для работы с конфиденциальными документами, соблюдая строгие требования безопасности.

Для крупных клиентов доступна кастомизация моделей под специфические задачи. La Plateforme предоставляет инструменты для fine-tuning, позволяющие адаптировать модели к отраслевой специфике, корпоративной терминологии и внутренним процессам компании. Клиенты могут обучать модели на своих данных, сохраняя при этом полный контроль над информацией. Поддерживается дистилляция моделей — создание более компактных версий, оптимизированных для конкретных задач.

Среди корпоративных клиентов Mistral AI — ведущие европейские организации. Французский банк BNP Paribas использует модели для оптимизации процессов в продажах, обслуживании клиентов и анализе рынков. Судоходная компания CMA CGM заключила партнёрство на 100 млн евро, используя Mistral для внутреннего персонального ассистента MAIA, который помогает сотрудникам быстро находить и обрабатывать информацию. Министерство обороны Франции применяет технологии Mistral в своих системах, что подчёркивает доверие к безопасности решений компании.

Корпоративные клиенты получают выделенную поддержку, соглашения об уровне обслуживания (SLA) и возможность развёртывания на собственной инфраструктуре. Mistral AI работает с клиентами над созданием специализированных решений — от обучения моделей до полного развёртывания, с экспертным сопровождением на всех этапах. Компания также предлагает Team-тарифы для командной работы и Enterprise-решения с максимальными возможностями настройки и интеграции.

Партнёрские интеграции

Стратегия распространения Mistral AI основана на широких партнёрствах с ведущими технологическими компаниями и облачными провайдерами. Сотрудничество с Microsoft началось в феврале 2024 года с инвестиций в размере 16 млн долларов. Модели Mistral доступны на платформе Azure через Azure AI Studio и Azure Machine Learning, становясь второй после OpenAI компанией, предлагающей коммерческие языковые модели на Azure. Партнёрство даёт Mistral доступ к вычислительной инфраструктуре Azure для разработки следующего поколения моделей.

С Amazon Web Services модели Mistral доступны через Amazon Bedrock — управляемый сервис для развёртывания языковых моделей. На Google Cloud Platform решения Mistral интегрированы в Google Vertex AI. Сотрудничество с IBM позволяет использовать модели через платформу IBM watsonx.ai, предоставляя доступ к обширной клиентской базе IBM. Модели также доступны через Snowflake Cortex AI и другие специализированные платформы.

Важное партнёрство заключено с NVIDIA — мировым лидером в производстве GPU для искусственного интеллекта. NVIDIA участвует в инвестиционных раундах и предоставляет вычислительные ресурсы для обучения моделей. В июне 2025 года Mistral и NVIDIA объявили о создании Mistral Compute — европейской AI-инфраструктуры, призванной стать альтернативой американским облачным гигантам. ASML, крупнейший производитель оборудования для производства микрочипов, инвестировала 1,3 млрд евро и владеет 11% компании, планируя тесное сотрудничество для развития AI-экосистемы.

Mistral AI интегрирована с более чем 20 бизнес-платформами через Model Context Protocol (MCP). Это включает системы управления проектами Atlassian, репозитории кода GitHub, платформы данных Databricks и Snowflake, платёжный сервис Stripe и другие. В январе 2025 года заключено соглашение с информационным агентством Agence France-Presse (AFP), дающее Le Chat доступ к текстовому архиву AFP с 1983 года. Также компания сотрудничает с французским оператором связи Orange, автопроизводителем Stellantis и немецким оборонным стартапом Helsing.

Главное о Mistral AI

Mistral AI за два с половиной года прошла путь от амбициозной идеи трёх исследователей до компании стоимостью 14 млрд долларов — крупнейшего европейского игрока на рынке искусственного интеллекта. Компания доказала, что европейский стартап способен создавать языковые модели мирового класса, конкурирующие с решениями от OpenAI, Google и Anthropic. Философия открытости, многоязычность и соответствие европейским стандартам защиты данных делают Mistral AI уникальным предложением на рынке.

Для разработчиков и компаний Mistral AI предлагает мощные инструменты по доступным ценам. Открытые модели под лицензией Apache 2.0 дают полный контроль над технологией и возможность локального развёртывания. Бесплатный тариф La Plateforme позволяет экспериментировать без финансовых вложений. Снижение цен на коммерческие API делает использование передовых моделей доступным для малого и среднего бизнеса. Интеграция с ведущими облачными платформами и корпоративными инструментами упрощает внедрение в существующие процессы.

Mistral AI продолжает активно развиваться, регулярно выпуская новые модели и улучшая существующие. Компания работает над расширением мультимодальных возможностей, улучшением способностей к рассуждению и созданием региональных моделей для специфических языков и культур. Ключевое преимущество — европейский подход к ИИ с гарантиями соблюдения GDPR, независимостью от американских технологических гигантов и нативной поддержкой европейских языков. Если вы ищете европейскую альтернативу американским ИИ-сервисам или проект, требующий локального развёртывания с полным контролем над данными, Mistral AI — очевидный выбор.