Нейросети уже сейчас меняют вашу жизнь: они переводят тексты, рекомендуют фильмы, помогают врачам ставить диагнозы. Понимание принципов их работы поможет вам эффективно использовать ИИ-инструменты в работе и личных задачах. В этом руководстве мы объясним сложные концепции простыми словами. Вы узнаете, как создать первую нейросеть и применить знания на практике.

Что такое нейросети

Определение и основные принципы

Нейросеть — это компьютерная система, которая учится решать задачи на примерах. Она состоит из искусственных нейронов, связанных между собой. Каждый нейрон получает информацию, обрабатывает её и передаёт дальше.

Принцип работы похож на человеческий мозг. В мозге человека около 86 млрд нейронов. Каждый связан с тысячами других через синапсы. В нейросети нейроны тоже передают сигналы через связи с весами.

Основные компоненты нейросети включают:

- Нейроны — базовые вычислительные элементы

- Связи — соединения между нейронами с весовыми коэффициентами

- Слои — группы нейронов, выполняющие определённые функции

- Активационные функции — определяют выходной сигнал нейрона

Современные нейросети содержат от сотен до миллиардов параметров. GPT-3 имеет 175 миллиардов параметров. Эти параметры настраиваются в процессе обучения. Чем больше параметров, тем сложнее задачи может решать система.

История развития

Первую математическую модель нейрона создали Маккаллок и Питтс в 1943 году. Они показали, как простые элементы могут выполнять логические операции. Это заложило основу для всех будущих разработок.

В 1957 году Фрэнк Розенблатт изобрёл персептрон — первую обучающуюся нейросеть. Она могла распознавать простые образы. Но возможности были ограничены — персептрон решал только линейно разделимые задачи.

В 2012 году AlexNet выиграла конкурс ImageNet с ошибкой 15,3% против 26,2% у конкурентов. Этот момент стал переломным для глубокого обучения. Учёный Ян ЛеКун назвал победу AlexNet поворотным моментом в истории ИИ.

Отличия от обычных программ

Обычная программа работает по чётким алгоритмам. Программист заранее прописывает каждый шаг. Нейросеть учится на примерах и находит закономерности самостоятельно.

Основные различия между подходами:

- Программирование vs обучение — код против данных

- Детерминированность vs адаптивность — фиксированная логика против гибкого поведения

- Точность vs устойчивость — требование идеальных данных против работы с шумом

- Интерпретируемость vs эффективность — понятная логика против сложных паттернов

Традиционные программы требуют точных исходных данных. Нейросети работают с зашумлёнными и неполными данными. Они могут делать выводы даже при отсутствии части информации.

Главное преимущество нейросетей — способность обобщать. Обученная на тысячах фотографий кошек, сеть распознает кошку на новом изображении. Она выделяет общие признаки без специального программирования.

Биологические основы

Биологический нейрон передаёт сигнал за 1-2 миллисекунды. Искусственный нейрон обрабатывает информацию в наносекундах. Скорость компенсирует разницу в сложности обработки.

В мозге действует принцип «всё или ничего». Нейрон либо передаёт сигнал, либо молчит. Искусственные нейроны работают с непрерывными значениями. Это даёт больше гибкости в обучении.

Один нейрон мозга имеет до 10 000 синапсов. Искусственный нейрон может иметь миллионы связей. Такая плотность соединений позволяет решать сверхсложные задачи.

Вообразите все нейросети мира в одном окне — это FICHI.AI

Попробуйте бесплатноКак работают нейросети

Архитектура нейронной сети

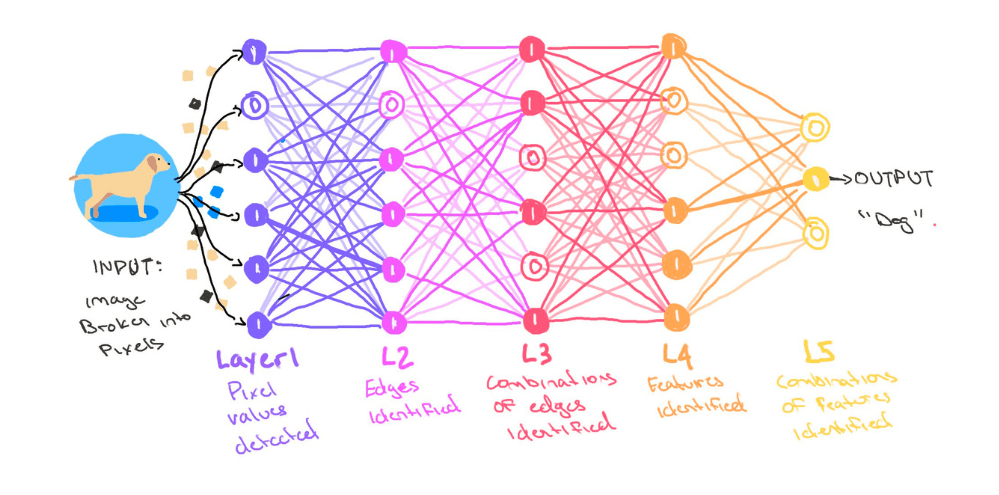

Простейшая сеть состоит из трёх слоёв: входного, скрытого и выходного. Входной слой получает данные. Скрытый слой обрабатывает информацию. Выходной слой выдаёт результат.

Глубокие сети могут иметь сотни слоёв. Модель ResNet содержит до 152 слоёв. Каждый слой выделяет определённые признаки. Первые слои находят простые паттерны, последние — сложные закономерности.

Количество нейронов в слое определяет его вычислительную мощность. Больше нейронов — выше точность, но требуется больше ресурсов. Архитектуру подбирают под конкретную задачу.

Процесс обучения

Обучение начинается с подачи примеров. Сеть делает предсказание и сравнивает его с правильным ответом. Ошибка показывает, насколько неточен результат.

Алгоритм обратного распространения корректирует веса связей. Он уменьшает ошибку, изменяя параметры сети. Процесс повторяется тысячи раз до достижения нужной точности.

Скорость обучения обычно составляет 0,001-0,1. Слишком высокая скорость приводит к нестабильности. Слишком низкая замедляет процесс. Правильный баланс критичен для успеха.

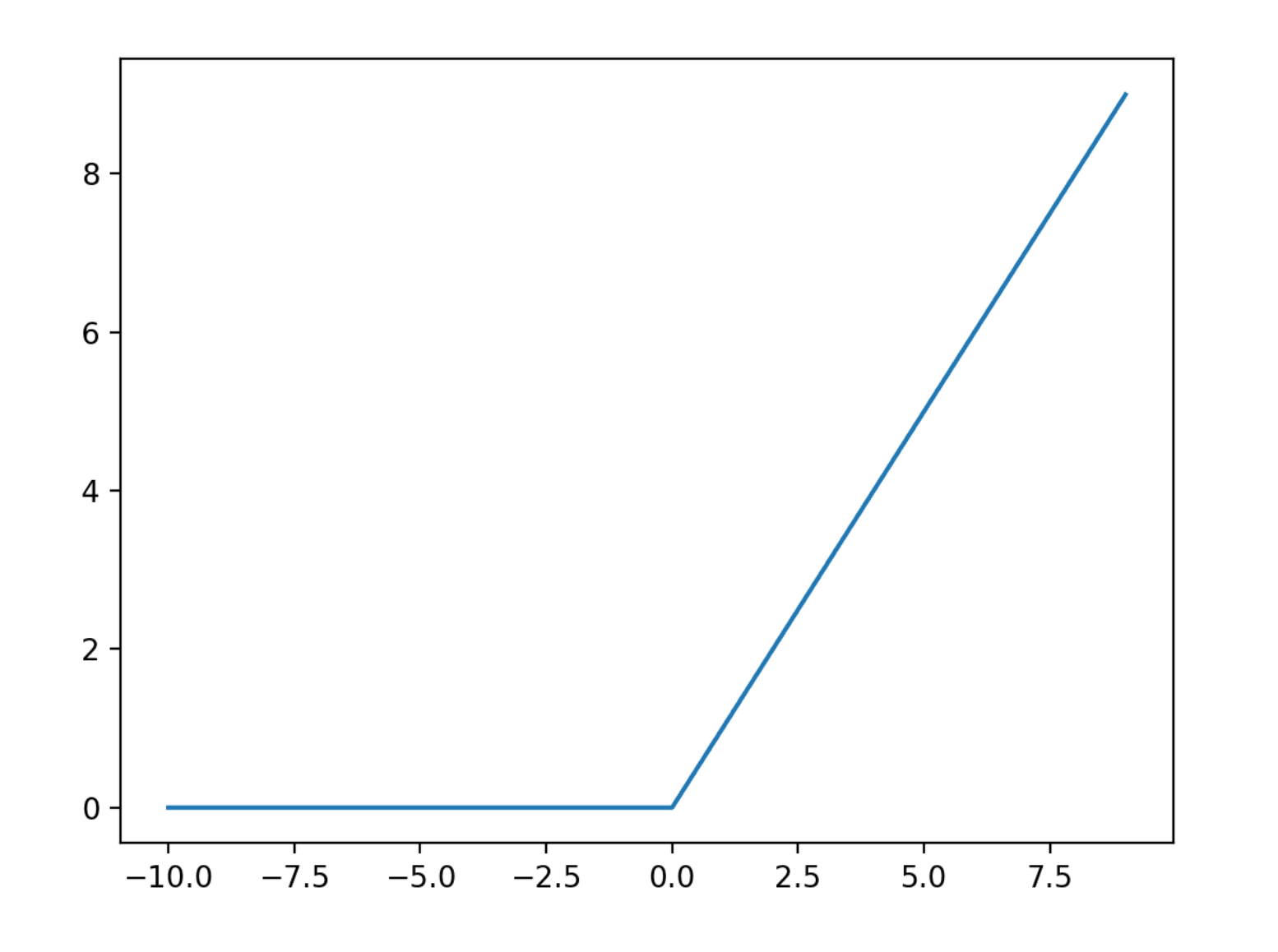

Активационные функции

Функция ReLU работает в 6 раз быстрее сигмоиды и тангенса. Она пропускает положительные значения и обнуляет отрицательные. Простота обеспечивает эффективность вычислений.

Функция softmax используется для классификации на множество классов. Она превращает любые числа в вероятности. Сумма всех выходов всегда равна единице.

Функция tanh даёт значения от -1 до 1. Она полезна для задач, где важна симметрия относительно нуля. Используется реже из-за проблемы исчезающего градиента.

Алгоритмы оптимизации

Оптимизатор Adam сочетает преимущества двух популярных методов. Он автоматически настраивает скорость обучения для каждого параметра. Это ускоряет сходимость и повышает стабильность.

Размер батча (общее число тренировочных объектов, представленных в одной партии или группе) влияет на качество и скорость обучения. Маленькие батчи дают более точные градиенты. Большие батчи ускоряют вычисления, но могут снизить точность.

Регуляризация предотвращает переобучение. Dropout случайно отключает нейроны во время тренировки. L2-регуляризация штрафует за большие веса. Эти методы помогают сети лучше работать на новых данных.

Типы нейросетей

Существует множество архитектур нейросетей, каждая оптимизирована для определённых задач. Выбор типа зависит от характера данных и целей проекта.

| Тип сети | Область применения | Ключевые особенности | Примеры |

| Персептрон | Простая классификация | Один слой, линейная разделимость | Логические операции |

| Многослойный персептрон | Классификация, регрессия | Несколько слоёв, нелинейность | Предсказание цен |

| Свёрточная сеть | Компьютерное зрение | Фильтры, пулинг | Распознавание изображений |

| Рекуррентная сеть | Последовательности | Память, обратные связи | Обработка текста |

Гибридные архитектуры сочетают преимущества разных типов. Например, CNN-LSTM объединяет свёртки для изображений и память для видео. Transformer использует механизм внимания для параллельной обработки.

Персептроны

Персептрон — простейший тип нейросети из одного слоя. Он может решать только линейно разделимые задачи. Например, классифицировать точки по разные стороны от прямой линии.

Обучение персептрона гарантированно завершится за конечное число шагов. Если задача решима, алгоритм найдёт решение. Это делает персептрон надёжным для простых задач.

Ограничения персептрона привели к «Зиме ИИ» в 1970-х. Он не мог решить задачу «ислючающего ИЛИ». Многие потеряли интерес к нейросетям на десятилетия.

Многослойные персептроны

Добавление скрытых слоёв кардинально расширяет возможности. Многослойный персептрон может аппроксимировать любую непрерывную функцию. Это универсальная теорема аппроксимации.

Нелинейные активационные функции — ключ к мощности многослойных сетей. Без них любое количество слоёв эквивалентно одному линейному преобразованию. Нелинейность создаёт сложность.

Эти сети решают задачи классификации и регрессии. Классификация определяет категорию объекта. Регрессия предсказывает числовое значение. Одна архитектура подходит для разных типов задач.

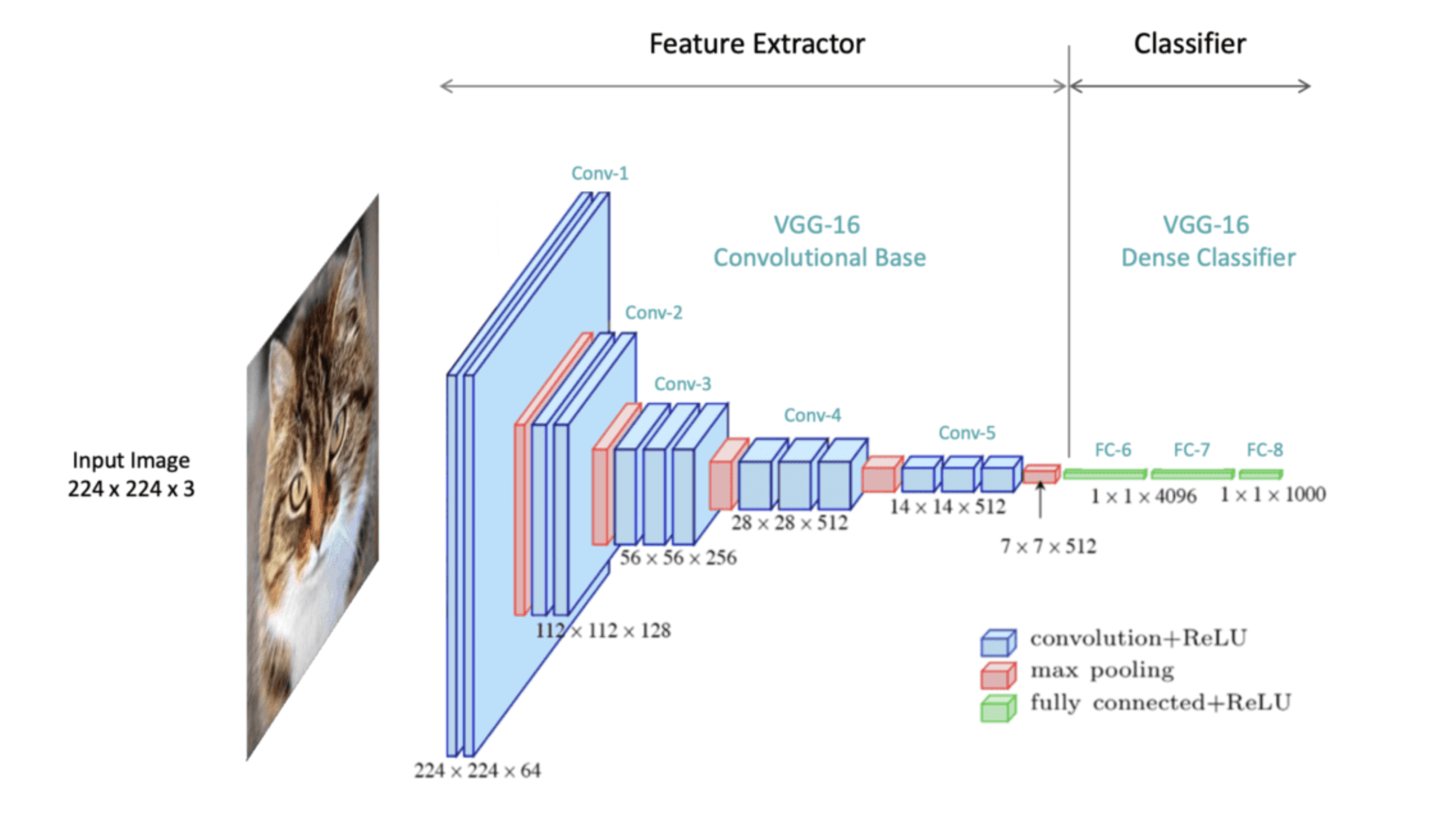

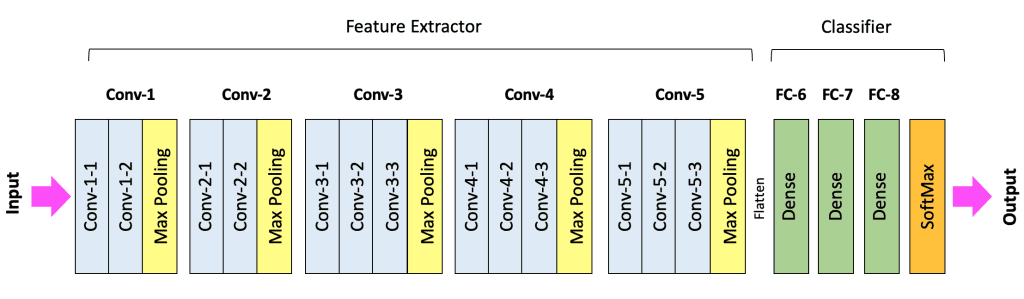

Свёрточные нейросети

Свёрточные сети специализируются на обработке изображений. Они используют фильтры размером обычно 3×3 или 5×5 пикселей. Фильтры ищут определённые паттерны: края, углы, текстуры.

Операция свёртки значительно сокращает количество параметров. Вместо миллиардов связей используются тысячи фильтров. Это делает обучение быстрее и эффективнее.

Пулинг уменьшает размер изображения, сохраняя важную информацию. Максимальный пулинг берёт наибольшее значение из области. Это создаёт устойчивость к небольшим сдвигам объектов.

Рекуррентные нейросети

Рекуррентные сети обрабатывают последовательности данных. У них есть память — они помнят предыдущие состояния. Это позволяет анализировать тексты, речь, временные ряды.

LSTM (Long Short-Term Memory) решает проблему исчезающего градиента. Она может запоминать информацию на тысячи шагов назад. Специальные «ворота» контролируют поток информации.

Архитектура Transformer заменила RNN во многих задачах. Она обрабатывает всю последовательность параллельно. Это даёт значительный выигрыш в скорости обучения и качестве результатов.

Области применения

Компьютерное зрение

Точность распознавания лиц достигает 99,9%. Современные системы превзошли человека в некоторых задачах. Они работают круглосуточно без усталости и ошибок внимания.

Автопилот Tesla использует 8 камер одновременно. Нейросети обрабатывают видео в реальном времени. Они распознают дорожные знаки, разметку, другие автомобили и пешеходов.

Медицинские системы диагностируют рак кожи лучше врачей. ИИ анализирует рентгеновские снимки, КТ и МРТ. Он находит патологии, которые человек может пропустить.

Обработка естественного языка

Google Translate поддерживает более 100 языков. Качество перевода приближается к человеческому уровню. Нейросети понимают контекст и идиомы.

ChatGPT обучен на 45 ТБ текстовых данных. Эта информация эквивалентна миллионам книг. Модель может поддерживать диалог на любую тему.

Доступ к GPT без VPN

Попробуйте продвинутого чат-бота на базе GPT — без VPN и регистрации. Просто зайдите и начните диалог.

Начать чатГолосовые помощники понимают 95% обычной речи. Они распознают акценты и диалекты. Обработка происходит мгновенно, часто прямо на устройстве.

Финансы и бизнес

Алгоритмическая торговля выполняет 60-75% всех сделок на бирже. ИИ анализирует новости, отчёты компаний, технические индикаторы. Решения принимаются за миллисекунды.

Системы скоринга обрабатывают заявки за секунды. Они оценивают кредитоспособность по сотням параметров. Точность оценки превышает традиционные методы.

Рекомендательные системы увеличивают продажи на 10-30%. Netflix, Amazon, YouTube используют ИИ для персонализации. Алгоритмы изучают предпочтения каждого пользователя.

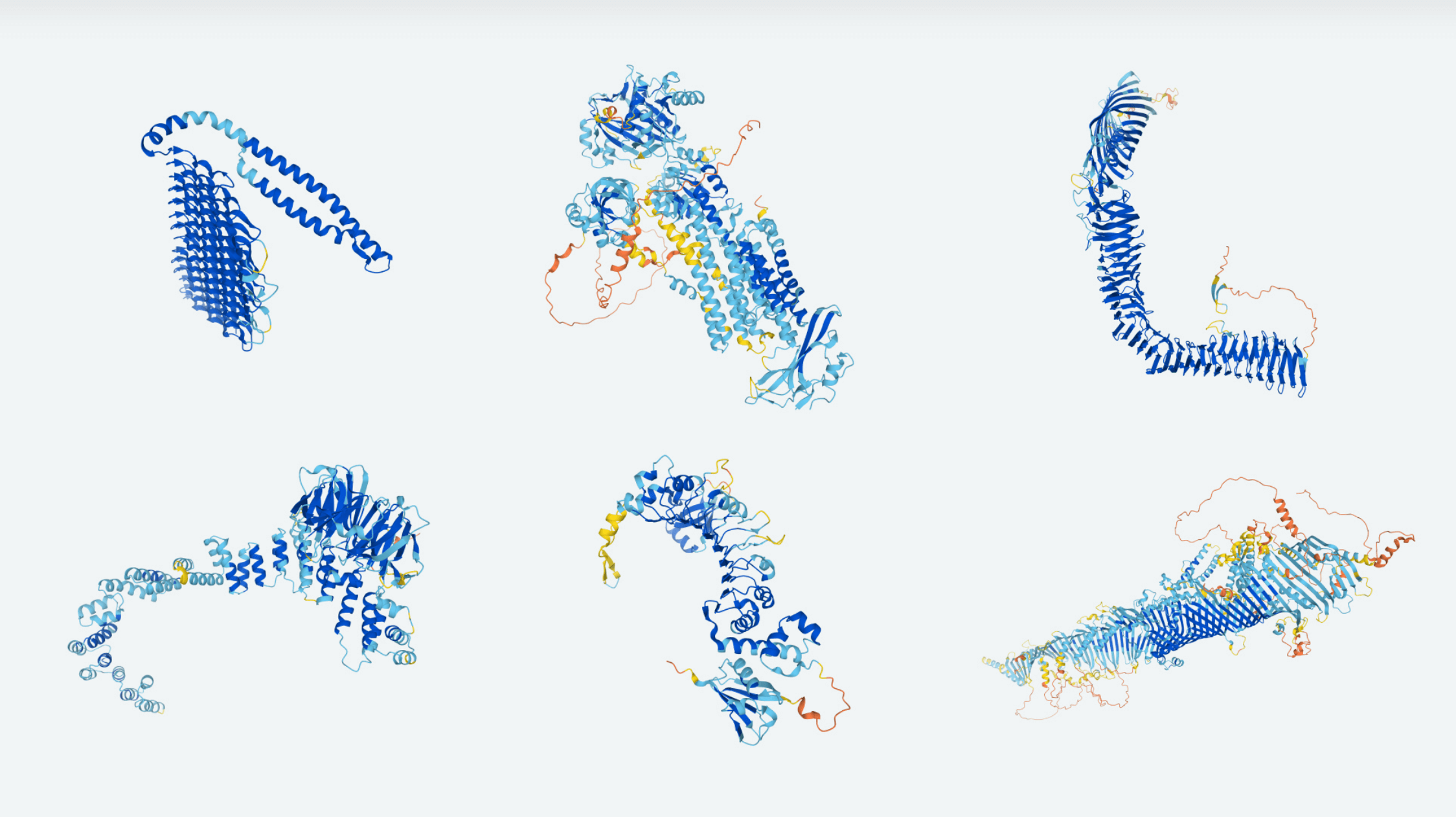

Наука и медицина

AlphaFold предсказал структуру 200 млн белков. Эта задача раньше требовала месяцы лабораторной работы для одного белка. ИИ решает её за минуты.

Прогнозы погоды стали точнее на 20% за 10 лет. Нейросети обрабатывают данные с тысяч метеостанций и спутников. Они учитывают сложные атмосферные процессы.

ИИ сокращает время разработки лекарств с 10-15 до 3-5 лет. Алгоритмы моделируют взаимодействие молекул. Они отбирают перспективные соединения до начала испытаний.

Практическое применение

Инструменты и платформы

TensorFlow используют Google, Uber, Airbnb. Это открытая библиотека для машинного обучения. Она поддерживает обучение на GPU и TPU.

Популярные инструменты разработки:

- TensorFlow — промышленные решения, масштабируемость

- PyTorch — исследования, простота отладки

- Keras — высокоуровневый API, быстрое прототипирование

- Scikit-learn — классические методы машинного обучения

- OpenCV — обработка изображений и видео

PyTorch предпочитают исследователи (60% научных статей). Библиотека проще в использовании и отладке. Динамические графы вычислений упрощают эксперименты.

AWS, Google Cloud, Azure предоставляют готовые ML-сервисы. Они включают предобученные модели и автоматизированное обучение. Можно запустить проект за несколько кликов.

Создание простой нейросети

Набор данных MNIST содержит 60 тысяч изображений цифр. Это стандартная задача для изучения нейросетей. Каждое изображение — чёрно-белое 28×28 пикселей.

Пошаговый процесс создания нейросети:

- Загрузка и предобработка данных MNIST

- Создание архитектуры сети (входной слой 784 нейрона, скрытый слой 128, выходной 10)

- Выбор функции потерь и оптимизатора

- Обучение модели на тренировочных данных

- Тестирование точности на валидационном наборе

- Сохранение обученной модели

Простая сеть обучается на MNIST за 5-10 минут. Достаточно двух слоёв по 128 нейронов каждый. Современный компьютер справляется без специального оборудования.

Точность на MNIST может достигать 99,5%. Лучшие модели ошибаются реже человека. Они правильно классифицируют даже неразборчивые цифры.

Оценка качества работы

Метрика Accuracy показывает долю правильных ответов. Она простая и понятная, но может вводить в заблуждение. При несбалансированных данных нужны дополнительные метрики.

F1-score учитывает точность (precision) и полноту (recall) одновременно. Точность — доля правильных среди найденных. Полнота — доля найденных среди существующих.

Кросс-валидация использует 80% данных для обучения, 20% для проверки. Данные разделяют несколько раз случайным образом. Это даёт более надёжную оценку качества модели.

Внедрение в производство

Inference на GPU в 10-100 раз быстрее CPU. Графические процессоры оптимизированы для параллельных вычислений. Это критично для обработки больших объёмов данных.

Модели можно сжать в 10-100 раз без потери качества. Квантизация уменьшает точность чисел. Прунинг удаляет неважные связи. Дистилляция переносит знания в меньшую модель.

Облачные решения стоят от $0,0001 за запрос. Цена зависит от сложности модели и объёма данных. Для большинства задач стоимость незначительна.

Откройте доступ к 70+ нейросетям в одном интерфейсе

Попробуйте бесплатноВызовы и ограничения

Технические ограничения

Обучение GPT-3 стоило около $12 млн. Крупные модели требуют тысячи GPU на месяцы. Такие ресурсы доступны только большим компаниям.

Требуется минимум 1000 примеров на класс для качественного обучения. При недостатке данных модель переобучается. Она запоминает примеры вместо изучения закономерностей.

Современные модели потребляют энергию как небольшой город. Обучение одной большой модели производит столько CO2, как несколько автомобилей за год. Экологический вопрос становится критичным.

Этические вопросы

Системы распознавания лиц ошибаются чаще для темнокожих людей. Предвзятость в данных переносится в модели. Это создаёт дискриминацию в автоматических системах.

ИИ может заменить 40% рабочих мест в ближайшие 15 лет. Автоматизация затронет не только физический труд. Под угрозой аналитики, переводчики, даже программисты.

85% решений ИИ невозможно объяснить человеку. Глубокие сети работают как «чёрный ящик». Это проблема для медицины, права, других критичных областей.

Безопасность и надёжность

Adversarial примеры могут обмануть 99% современных моделей. Специально подготовленные данные заставляют ИИ ошибаться. Злоумышленники могут использовать это для атак.

Автопилоты попадают в аварии в 0,2 случаях на млн миль. Это лучше среднего водителя, но хуже лучших. Общество пока не готово принять ошибки машин.

Data poisoning может снизить точность модели на 50%. Подмешивание вредоносных данных в обучающую выборку нарушает работу ИИ. Защита от таких атак — активная область исследований.

Правовое регулирование

ЕС принял AI Act в 2024 году. Закон классифицирует ИИ-системы по уровню риска. Высокорисковые приложения требуют сертификации и аудита.

В Китае действует рейтинг алгоритмов с 2022 года. Компании должны регистрировать алгоритмы рекомендаций. Государство контролирует влияние ИИ на общественное мнение.

30 стран разрабатывают национальные стратегии ИИ. Правительства понимают важность технологии. Регулирование балансирует между инновациями и безопасностью.

Заключение

Нейросети превратились из научной экзотики в основу современной цифровой экономики. Они обрабатывают ваши фотографии, переводят тексты, рекомендуют контент. Понимание их принципов работы — это уже не роскошь, а необходимость.

Ключевые выводы для практического применения:

- Начинайте с простых задач — классификация изображений или текстов

- Используйте готовые решения и предобученные модели

- Собирайте качественные данные — они важнее сложных алгоритмов

- Изучайте этические аспекты и ограничения технологии

- Следите за развитием регулирования в вашей сфере

Будущее нейросетей связано с повышением эффективности и снижением потребления ресурсов. Квантовые вычисления и нейроморфные чипы откроют новые возможности. Главный вызов — создание безопасного и объяснимого ИИ, которому можно доверить критически важные решения.

Инвестируйте время в изучение нейросетей уже сейчас. Эти знания станут конкурентным преимуществом в любой профессии. Технология развивается стремительно, но базовые принципы остаются неизменными.